人工智能如何用到二次元?日本这家神秘组织研究了三年

导读:自动给美少女加猫耳,根据画风判断画师,建立 GalGame 推荐系统 人工智能可不只是会下围棋。

自动给美少女加猫耳,根据画风判断画师,建立 GalGame 推荐系统......人工智能可不只是会下围棋。

本文原创首发于「百度大脑」微信公众号(ID:baidubrain),关注百度大脑,读懂人工智能。

关于深度学习能做什么,业界主流都在积极就着关乎人类未来生活的课题开展研究:无人驾驶、语音识别、聊天机器人……

但对于人类独特的种族之一御宅族,有人关心他们的未来生活吗?!别担心,技术宅们已经开始自救了。

「百度大脑洞」专栏将带你见识 AI 领域那些不可思议的研究。这一期,我们看看御宅族们创造出了哪些未来道具。

要说到那些「我去!这也行」的二次元人工智能研究成果,必须要提到 SIG2D,一家将深度学习技术应用到二次元中的神秘机构。

就如他们的名字 Special Interest Group on 2D Information Processing 一样正经,他们的研究内容就是「二次元信息处理」。

每年冬天,他们都会发布当年的研究成果。这是他们的研究报告封面,大家先感受下↓

SIG2D 的成员都出身神秘。他们的名字都来自动漫里的人物。

橘叶月来自《星辰恋曲的白色永恒》中的月之咲幼稚园,是一位懂事的小姑娘。她写过一篇深度学习教程,题为《叶月酱都能学会的 Deep Learning 技巧》。

鹿野上悠马来自宁静的港口小镇风津ヶ浜,是《五彩斑斓的世界》的主人公,他在研究用机器学习判断画中人是否为自己在漫画里的妻子二阶堂真红。

这些来自二次元的 SIG2D 的成员们,试图用学术的态度研究深度学习在二次元中的应用。他们发表的每篇论文从摘要、导论到实验方法、实验评估到结论都力求格式严谨,论证严密。来看看他们的成果吧。

自动给美少女加上兽耳

一键猫耳换装

这个项目是为了满足各位兽耳爱好者。从 SIG2D 的看板娘(研究报告封面中的垂耳图少女)就可以看出,他们也是一群兽耳爱好者。

喜爱兽耳但绘画技术难以出手怎么办?SIG2D 的成员们就自己写了一个自动兽耳生成器。

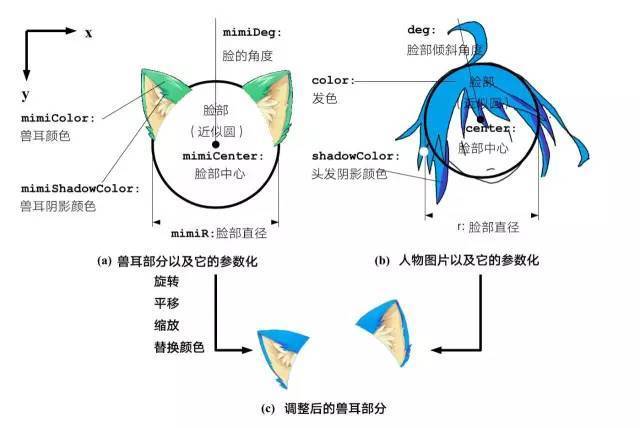

使用者只需要拖拽图片到网页里,计算机就会根据角色头部倾斜角度、整体画风自动加上一个合适的兽耳。

对,双击还可以换成兔耳、犬耳、狐耳……

为了降低违合感,兽耳的颜色还会根据角色的发色变化,机器会吸取原本发色和阴影颜色替换。

实现原理分析,引用、翻译自论文《给妹妹加上兽耳》。[2]

要完成这个任务,深度学习必不可少。它的作用主要在体现在脸部识别这个步骤上。这个项目中使用了二次元脸部识别库 AnimeFace [1]提供的部分参数。为了提高脸部识别的能力,AnimeFace 准备了非常多的训练数据(7 万张脸部图片,3 亿张非脸部图片),最终达到了能精确识别脸、皮肤、头发、瞳色的效果。

在线试用

三次元照片警报器

用机器学习识别 2D/3D 图像

有时候,我们需要一个三次元照片警报器。

试想,你想在画师微博下找找他/她画的可爱的美少女治愈下心灵时,突然出现几张漫展结束后的聚会合照,瞬间残酷的三次元世界又浮现在我们眼前……我们需要防御这种意料之外的三次元打击。

要实现图片的精确搜索,我们需要知道图片的元数据。但是很多情况下元数据是不完整的。这时候,机器识别判断的能力非常重要。如何区别照片和绘画?颜色的鲜艳程度?边缘线条的锋利程度?这些特点都不够明确。即使人类能够很快分辨,但是对于机器来说却很难。

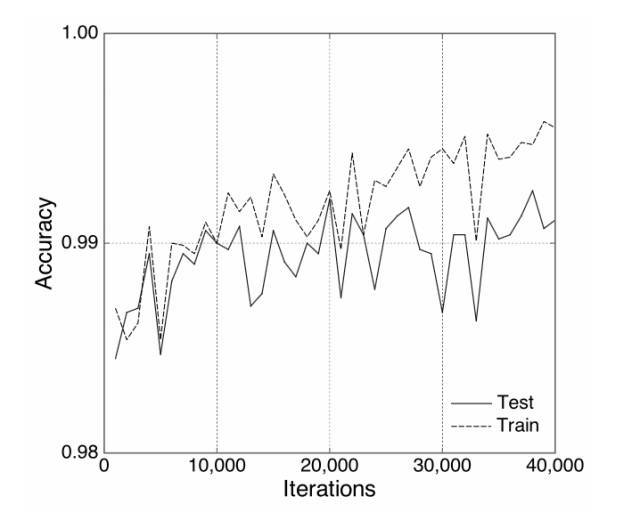

为解决这问题,SIG2D 在 2013 年和 2015 年展开了两次实验。分别用 Tumblr 和 ImageNet 上的照片和图片制成了数据集,第一次使用了支持向量机(SVM)和卷积神经网络(CNN),分别达到了 85.8% 和 94.7% 的准确率;第二次用到了深度学习库 Illustration2Vec,最终准确率最高达到了 99.3%[3][4]。

使用 Illustration2Vec,随着迭代次数增加,测试集与训练集的准确率也在波动上升,维持在 99% 左右。

神经网络识别美少女

判断画中的角色是否为二阶堂真红

左图是同人图,作者水明月こう(Pixiv id: 4371345),右图是二阶堂真红官方人物设定图。

这个实验[5]的本质和神经网络识别猫咪的实验有些相似。但对于宅来说,教会人工智能认识某个特定的美少女会让写代码更有动力一些。

SIG2D 选择的主角是二阶堂真红,《五彩斑斓的世界》的女主人公,身高 141cm,金发红瞳,喜欢古典音乐,外表稚嫩,但内心稳重。

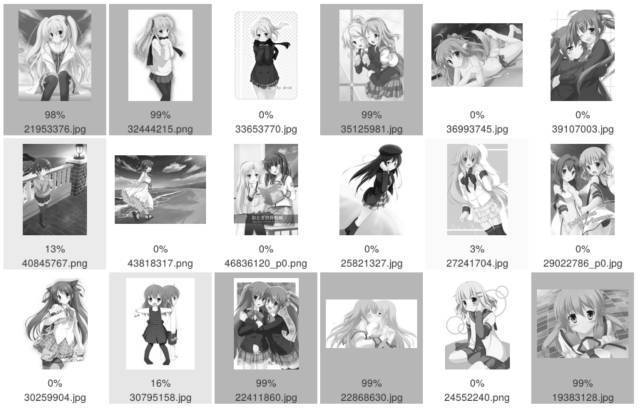

他们使用了深度学习框架 Caffe,数据集包括数百张真红图像与其他二次元美少女图像。通过训练,最终达到了 85% 的正确率。

Pixiv 用户 aqwiz 的绘画为例,以上是分类器的最终效果。高亮的图片被计算机判定为二阶堂真红。

用深度学习识别声优

「花泽香菜的声音化成灰我都认识!」

花泽香菜配音的部分角色。

能瞬间听出配音的声优是谁,也是御宅族引以为傲的技术之一。也只有这类人才能在《你的名字。》里小雪老师开口说话的瞬间就能察觉这就是《言叶之庭》里的女主角,因为两者声优都来自同一人:花泽香菜。

如何让计算机也分辨出声优是谁呢?SIG2D 用 Python 库 VoiceID 和 Java 库 LIUM 做了个实验,最终得到了 51% 的正确率[6]。虽然才过半,这也实属不易,毕竟声优是个怪物嘛。

除了 SIG2D,日本博主 Tetsuro Kitajima 也进行了类似的实验。他选用了深度学习框架 chainer 来进行实验,最终达到了最高 74% 左右的正确率[7]。

Tesuro 的实验结果,十次深度学习后得到的混淆矩阵。

用深度学习判断画师

画风太过相似

右边是甘露树的作品,左边是みつみ美里的作品。

有人把分辨 GalGame 画师的能力分成了几个等级。第一级是区分みつみ美里和甘露树的画。两人都是游戏公司 AQUAPLUS 的画师。他们的画风相当相似。但看多了之后,仍能找到好几处细节处理的不同。不过如果你在搜索引擎中搜索两人名字,也能找到「如何正确区分画师みつみ美里和甘露树的作品?」这样的问题[8]。

如果你能分辨出以上两人的画风,你已经能脱离萌萌新人的等级了。但如柚子社的こぶいち和むりりん的画风则更加相似。就算是熟悉两人风格的读者可能都无法分辨其中的差别。

左边是こぶいち的作品,右边是むりりん的作品[9]。

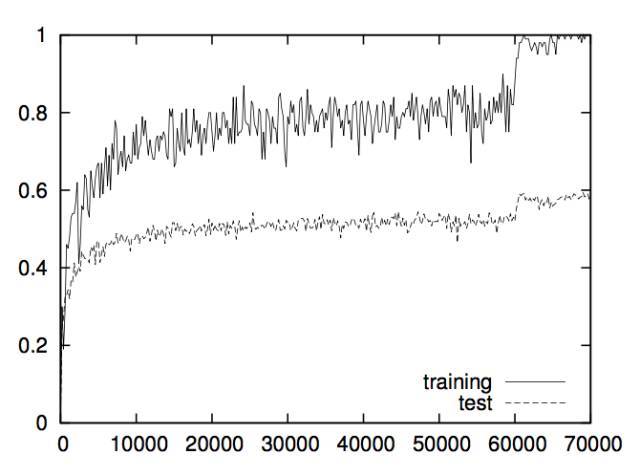

人类很难分辨,那用深度学习来判断画师会不会更加准确呢?SIG2D 就在 2014 年发表了一篇名为《用 Caffe 尝试判断画师》的论文[10]。他们使用了深度学习框架 Caffe,从 Pixiv 网站中选取了 40 位画师建立数据集。最终在进行 6 万次迭代后,从 40 张画中选 1 张的准确率达到 58% 左右。

找到喜欢的 GalGame

基于协同过滤的美少女游戏推荐系统

Nitro+ 作品,《你和她和她的恋爱》

不同的人喜欢的游戏风格不同。如果你给一个郁系游戏爱好者推荐萌系游戏,结果只能是友情破裂,相互无法理解。

为了防止此类冲突的发生,我们需要建立一个推荐系统:如果是爱好类似的人,可以总结玩家评价推荐给用户;同时也要屏蔽一系列完全风格不同的游戏。这与亚马逊的「猜你喜欢」系统很相似,但专为 GalGame 玩家设计。

于是,SIG2D 在日本最大的 GalGame 评价网站数据的基础上,制成了这样一个推荐系统。它包含了「批评空间」 12,390 个用户评价的 14,119 个作品之后获得的 685,956 条数据。通过了解用户对其他作品的评价,能给该用户推荐类似风格的作品[11]。

Bonus

放大两倍的老婆:waifu2x

虽然不是 SIG2D 发明的,waifu2x 以它名字和实用性闻名遐迩,我们有必要再介绍一下 。(为什么 waifu 等于 wife?这得归因于日语片假名中的强行收入外来语。但理解成拼音似乎也毫无违合感。)

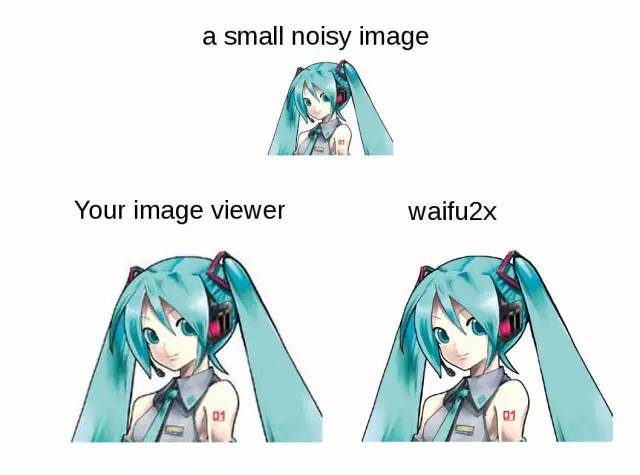

Waifu2x 是一个图片放大工具。它仅针对于动漫风格的图片,能把模糊的小图像无损放大两倍,并降低噪点、柔和曲线。我们从名字中就可以感受到开发者对于二次元美少女的爱意。

Waifu2x 的算法基于卷积神经网络技术。通俗地讲,这相当于一个拥有学习的能力的人工大脑:开发者丢给这个大脑几万张动漫美少女图片(记为 A),和几万张与 A 对应、宽高缩小一倍的缩略图(记为 B),让它学习从 B 出发,如何放大以尽量还原 A。等学成出来后,它就能得心应手地处理这类图片了。

我知道你可能看不懂上面的解释,但你要知道这项技术非常的实用!如果遇到喜欢的图但就是找不到高清大图,如果漫画的扫图不够清晰,如果喜欢的 GalGame CG 分辨率太低。这时候,用 waifu2x 拉一下,一切都被拯救了。